Hàm sigmoid

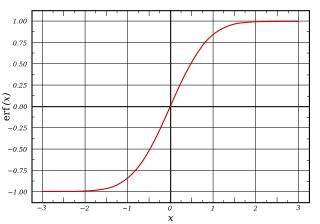

Hàm sigmoid là một hàm số có dạng đường cong hình "S" hay còn gọi là đường cong sigmoid. Một ví dụ phổ biến của một hàm sigmoid là hàm Lôgit, được thể hiện trong hình đầu tiên và có công thức định nghĩa như sau:[1]

Các hàm sigmoid tiêu chuẩn khác được đưa ra trong phần ví dụ bài này.

Các trường hợp đặc biệt của hàm sigmoid là hàm Gompertz (được sử dụng ở các hệ thống mô hình mà bão hòa tại các giá trị lớn của x) và đường cong ogee (được dùng trong đập tràn của một số con đập). Hàm sigmoid là vùng chứa các số thực, với giá trị trả về thường là hàm số tăng nhưng cũng có thể là hàm số giảm. Các hàm sigmoid thường thể hiện một giá trị trả về (trục y) trong khoảng từ 0 đến 1. Một khoảng phổ biến khác thường dùng là từ −1 đến 1.

Một loạt các hàm sigmoid bao gồm các hàm logistic và hàm hyperbolic đã được sử dụng làm hàm kích hoạt các mạng thần kinh nhân tạo. Các đường cong sigmoid cũng phổ biến trong các hàm thống kê như các hàm phân phối tích lũy (từ 0 đến 1), chẳng hạn như các tích phân của phân phối logistic, phân phối chuẩn, và phân phối t Student (Student's t-distribution).

Định nghĩa[sửa | sửa mã nguồn]

Một hàm sigmoid là một hàm bị chặn, hàm số khả vi, hàm thực mà được định nghĩa cho tất cả giá trị thực và chứa một đạo hàm không âm ở mỗi điểm[1] và có chính xác một điểm uốn cong (điểm quan trọng làm cho hàm có hình chữ S). Một hàm sigmoid và một cường cong sigmoid đều nói về cùng một đối tượng giống nhau.

Các ví dụ[sửa | sửa mã nguồn]

- Hàm hyperbolic (phiên bản thay đổi và thu nhỏ của hàm logistic, ở trên)

- Hàm smoothstep

- Một số hàm số đại số, ví dụ

Xem thêm[sửa | sửa mã nguồn]

| Wikimedia Commons có thêm hình ảnh và phương tiện truyền tải về Hàm sigmoid. |

Tham khảo[sửa | sửa mã nguồn]

- ^ a b Han, Jun; Morag, Claudio (1995). “The influence of the sigmoid function parameters on the speed of backpropagation learning”. Trong Mira, José; Sandoval, Francisco (biên tập). From Natural to Artificial Neural Computation. Lecture Notes in Computer Science. 930. tr. 195–201. doi:10.1007/3-540-59497-3_175. ISBN 978-3-540-59497-0.

- Mitchell, Tom M. (1997). Machine Learning. WCB–McGraw–Hill. ISBN 978-0-07-042807-2.. In particular see "Chapter 4: Artificial Neural Networks" (in particular pp. 96–97) where Mitchell uses the word "logistic function" and the "sigmoid function" synonymously – this function he also calls the "squashing function" – and the sigmoid (aka logistic) function is used to compress the outputs of the "neurons" in multi-layer neural nets.

- Humphrys, Mark. “Continuous output, the sigmoid function”. Bản gốc lưu trữ ngày 2 tháng 2 năm 2015. Truy cập ngày 18 tháng 6 năm 2020. Properties of the sigmoid, including how it can shift along axes and how its domain may be transformed.